무질서도.

엔트로피라는 개념은 잘 잡히지 않는 미꾸라지 같은 개념이다. 잡았다 싶으면 달아나 버리고 아리송한 개념이다. 더욱이 엔트로피의 개념은 1948년 미국 BellLabs의 ClaudeShannon이 MathematicalTheoryOfCommunication이란 획기적인 논문을 써서 수학적 개념으로 확대 승격시킨 이후 더욱 다양한 개념으로 발전 변화하였다.

카드를 A-K까지 순서대로 놓여져 있다면 우리는 그런 정보와 더불어 한곳만 뒤집어 보면 다음 것은 물론 전체를 다 파악할 수 있다. 이런 경우 Entropy가 아주 낮다. 가장 낮은 경우라면 아예 처음부터 A-K그대로 놓여있다고 보는 경우 아무 것도 뒤집어 보지 않아도 알 수 있다. 그런데 이번엔 반대로 완전히 섞여 있다면 완전히 섞여 있다는 정보를 가지고 있다고 해도 어디에 무엇이 있는지 전혀 알 수가 없다. 이것을 가지고 엔트로피 최대라고 할 수 있다.

Entropy is the minimum descriptive complexity of a random variable.

In ThermoDynamics

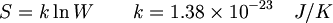

볼쯔만의 식

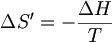

화학반응에서

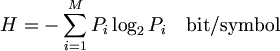

In InformationTheory

Average amount of information per symbol

Zero-memory binary information source에서 S={0,1}로 주어질때 0과 1의 발생Probability를 p,q로 놓으면 p+q=1를 통해, p만의 함수를 유도할 수 있다. 이를 EntropyFunction이라고 한다. 여기서의 H(S)는 log_2{r}보다는 항상 작은데, 이 비율을 RelativeEntropy라고 하며, MutualInformation과 관련되어 있다.

관련정보